基于这样的观察,我们提出了一种self-paced的Simple to Complex训练框架。我们首先从网络上下载大量的简单图片,然后通过显著性检测技术去获取其对应的显著图。进而利用显著图和语义标签作为监督信息去训练一个Initial的分割网络。特别地,在利用显著图作为监督信息的情况下每个pixel会以不同的概率属于物体或者背景。比如属于 “马” 的某个像素点可能以0.9和0.1的概率分别属于前景物体 “马” 和背景。在Initial网络训练完成后,其对简单图片已经具备了一定的分割能力,进而我们利用该网络预测出所有简单图片的masks,并利用这些masks训练一个Enhanced语义分割网络。最后我们通过Enhanced网络预测更多复杂图片的masks,并训练出一个更好的语义分割网络,即Powerful DCNN。

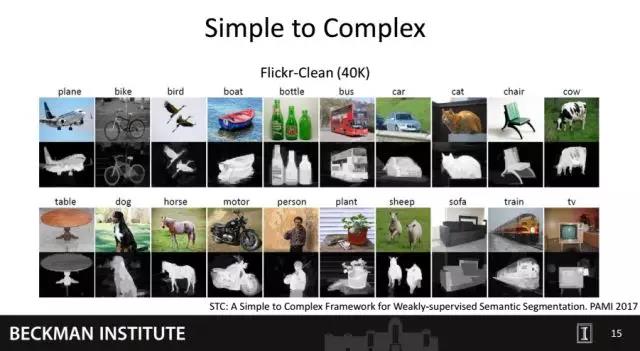

这个是我们构建的Flickr-Clean 简单图像库及部分图片对应显著图。可以看出通过显著图构建像素和语义之间关系的方式是很有效的。

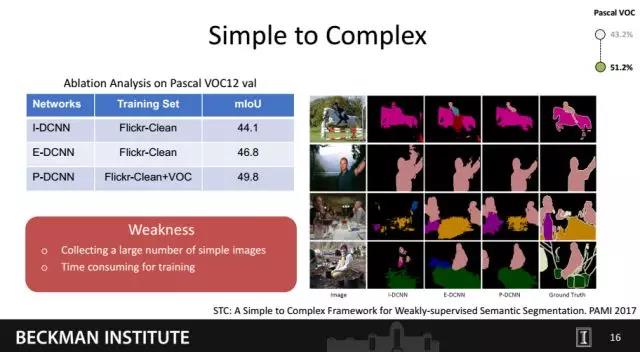

通过左边的表格可以看出,Initial, Enhanced和Powerful网络对图像的语义分割能力在不断增强。通过右边的结果图也可以看出分割效果变得越来越好。这个方法虽然很简单,但在Pascal VOC上比当时最好的性能高出十个百分点。然而这个方法也有两个很明显的缺点:1)必须收集大量的简单图片,否则很难训练出一个性能较高的Initial网络并不断提高;2)训练样本多,训练时间长。

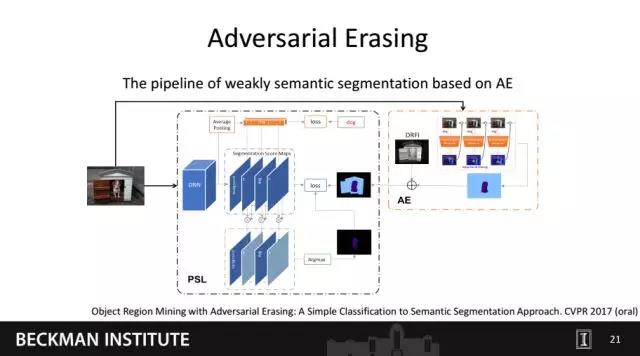

鉴于这些不足,我们希望可以发现一种不依赖于简单的图片的方法,并可以达到较高的语义分割性能。于是我们在2017年提出了Adversarial Erasing。

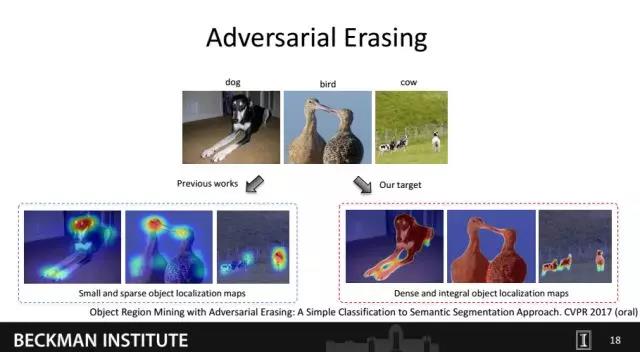

2016年发表在CVPR上的一篇文章(CAM)发现,分类网络可以通过Top-down的方式定位出图片上的哪些区域对物体分类的贡献较大,而这些区域往往属于对应语义的物体。然而,CAM方法的主要问题在于它只能发现最具判别力的一些物体区域(比如狗的头部),这些区域往往属于目标物体的某个part并且分布稀疏。这同语义分割需要定位完整物体的目标并不一致。

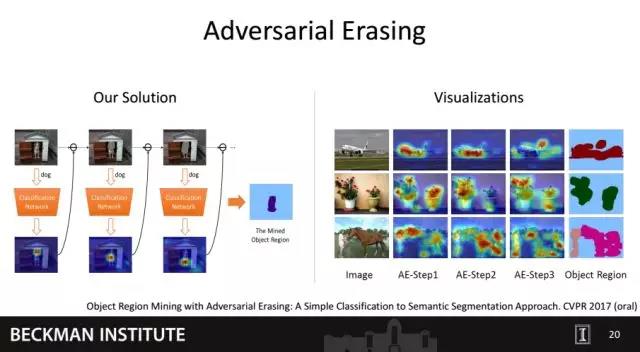

为了定位较为完整的物体,我们提出了一种Adversarial Erasing的方法。该方法的motivation主要是通过不断擦除物体上最具判别力的一些区域,使得分类网络发现更多的物体的其它区域。如左图所示,我们首先将包含狗的图片输入分类网络中,通过训练可以获得属于狗的最具判别力的区域,即狗的头部。进而我们将狗的头部从图片中擦除掉,并将擦除后的图片输入分类网络进行再训练。网络会寻找其它的证据使得图片可以被正确分类,进而找到狗的胸部。重复此操作,狗的脚部也可以进一步被发现。最后通过融合擦除掉的区域就可以获得物体的整个区域。右图给出了更多示例以及最后通过融合擦除区域获得的整个物体区域。

由于最终的目标是语义分割,我们最后把mining出的物体区域生成了图像的mask并用于训练语义分割网络,这部分在本文不做过多介绍,具体细节可以参阅paper。

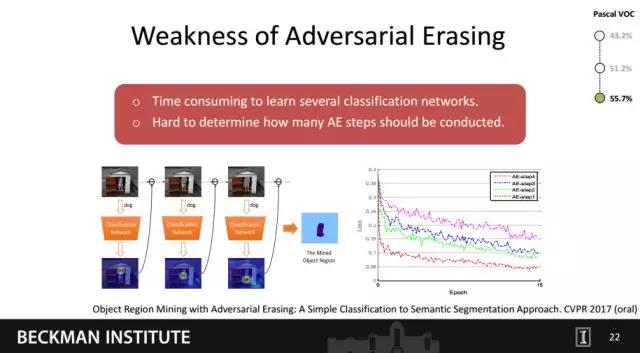

Adversarial Erasing方法没有用到任何额外数据,并在VOC12上获得了 55. 7的mIoU值。虽然这篇工作用更简单的方式(相对Simple to Complex) 获得了更高的性能,但也存在两个明显的问题:1)需要多次训练分类网络,时耗较高;2)对于每张训练图片很难确定何时停止擦除操作。我们在文章中采用通过观察分类网络收敛的loss值的方式来决定擦除的次数,但该方法很难保证所有训练图片都能达到最好的擦除效果。

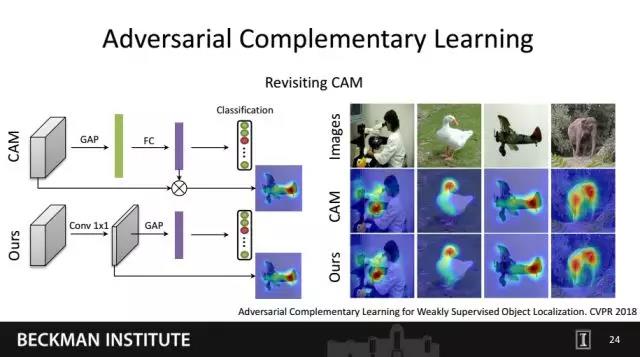

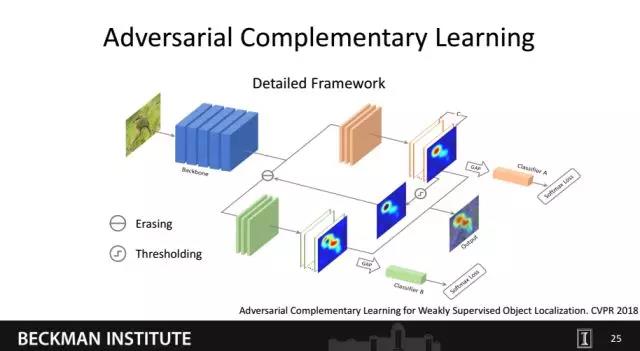

针对Adversarial Erasing的两个缺点,我们进一步提出了一种Adversarial Complementary Learning的方法,并被CVPR 2018录用。首先我们发现Network-in-Network中提出的Global Avg Pooling (GAP) + Classification Loss的方式就可以获得跟CAM方法中完全一样的物体定位图 (如右图所示),我们在文章里也给出了数学证明。有了这个前提,我们就可以很容易的将Adversarial Erasing的思想嵌入到训练过程中。

这是我们Adversarial Complementary Learning的框架图。我们首先利用一个分类网络来发现一些物体的判别区域,进而将这些区域从中间的特征图中擦除。我们将擦除后的特征图输入到另外一个分支中进行训练,进而获得同第一个分支互补的物体定位图。最后,我们将从两个分支获得物体定位图合并起来获得最终的结果。

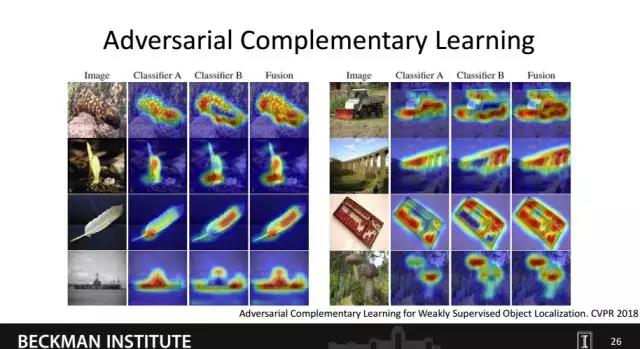

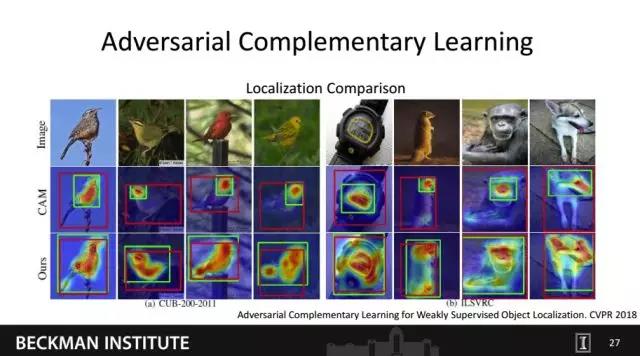

这是我们在ImageNet上的实验结果。可以看出不同的分类器定位的区域是具有互补性的,并且最后融合出了我们想要的结果。通过我们的定位图生成的物体框相比CAM方法也更加准确。

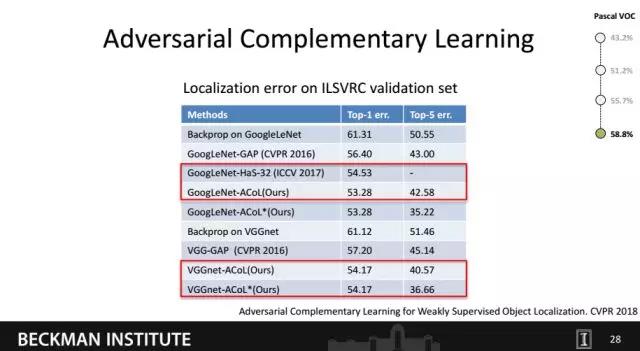

我们的方法在ImageNet上达到了最好的定位性能。同时也测试了在Pascal VOC测试了语义分割结果,性能相比Adversarial Erasing提升了3.1个百分点(55.7->58.8)。

*博客内容为网友个人发布,仅代表博主个人观点,如有侵权请联系工作人员删除。